Detailbeschreibung

AUSGANGSLAGE

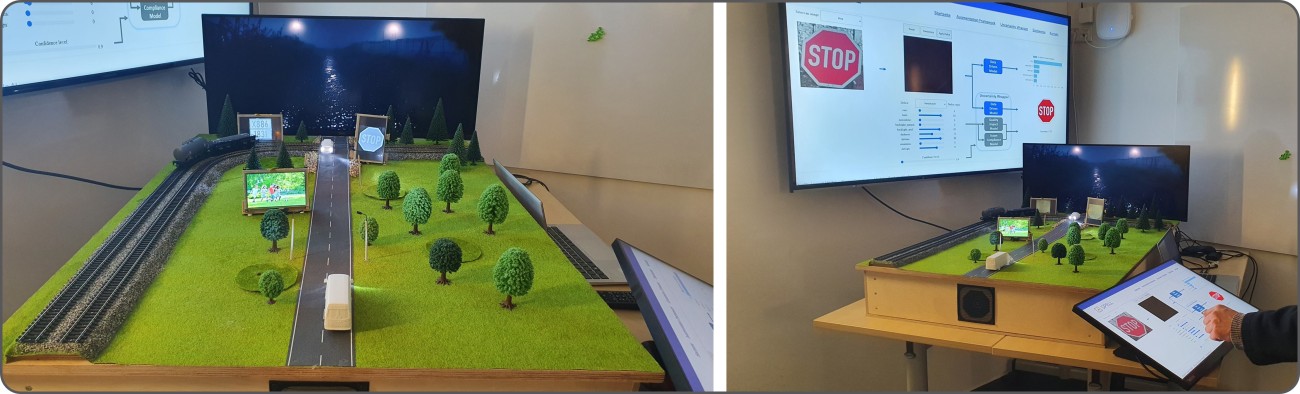

Vorhersagen von KI und Machine Learning Modellen sind nicht immer fehlerfrei, und die Modelle können manchmal fehlerhafte Vorhersagen treffen, ohne dass unmittelbar ersichtlich ist, warum dies der Fall ist. Diese Unsicherheit darüber, ob Vorhersagen richtig oder falsch sind, kann je nach Einsatzbereich schwerwiegende Folgen haben. Vor allem im Straßenverkehr wird hierzu immer wieder kontrovers diskutiert.

LÖSUNGSANSATZ

- Augmentierungs-Framwork:

- Erweiterung der Trainingsdaten mit Hilfe von realistischen Simulationen von Umweltbedingungen

- Verbesserte Robustheit und Genauigkeit der Modelle und effektives Training für anspruchsvolle Einsatzszenarien

- Uncertainty Wrapper

- Modellagnostische Quantifizierung von Unsicherheiten in den Modellausgaben

- Berechnung der Wahrscheinlichkeit, wie sicher oder unsicher die Vorhersage des Modells ist

POTENZIAL & ANWENDUNGSBEREICHE

- Schaffung einer transparenten Entscheidungsgrundlage durch die Ergänzung von Unsicherheitsbewertungen

- Entscheidungen der Modelle, insbesondere in Bildklassifikatoren, können klarer und nachvollziehbarer gemacht werden

- Anwendungsbereiche, z.B.:

- Verkehrszeichenerkennung

- Fußgängerdetektion

- Zellklassifizierung mittels Durchflusszytometriedaten